am吉他譜的問題,我們搜遍了碩博士論文和台灣出版的書籍,推薦郭志明寫的 Aguiter老師教你8堂課完全學會烏克麗麗【全新增訂版】 和陳加容的 烏克知音 (上)都 可以從中找到所需的評價。

這兩本書分別來自智富 和知音音樂所出版 。

國立屏東科技大學 機械工程系所 王栢村所指導 蘇秉翔的 小提琴設計製造之輔助工具模組及技術發展 (2020),提出am吉他譜關鍵因素是什麼,來自於小提琴、自動化分析、音場分析、聲音重建。

而第二篇論文實踐大學 資訊科技與管理學系碩士班 黃耀賢所指導 劉翼翬的 基於深度學習的MIDI生成器之研究與實作 (2019),提出因為有 MIDI生成、音樂相似度、深度學習、人工智慧、機器學習的重點而找出了 am吉他譜的解答。

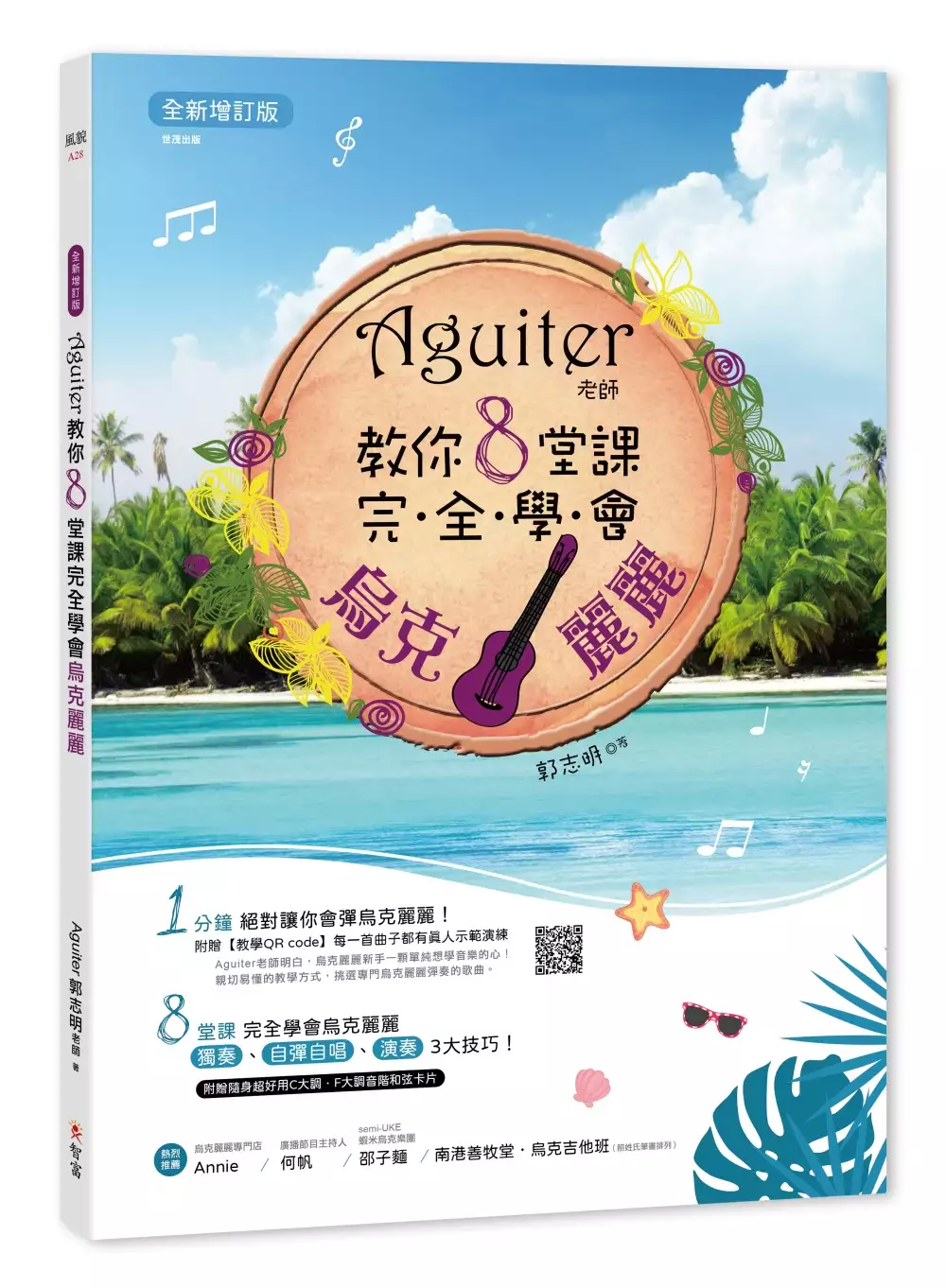

Aguiter老師教你8堂課完全學會烏克麗麗【全新增訂版】

為了解決am吉他譜 的問題,作者郭志明 這樣論述:

「把老師帶回家!」 市面上最詳盡的烏克麗麗影音教學書! 1分鐘絕對讓你會彈烏克麗麗! ★附贈【教學QR code】每一首曲子都有真人示範演練 相信大家都喜歡音樂,也懷有自彈自唱的夢想,或許不用很高超的技術、很複雜的樂理,只想純粹享受自己能彈奏音樂的快樂。 小巧可愛的烏克麗麗是療傷系的樂器,無論是流行歌曲、教會詩歌與心靈治療,都具有非常好的效果! 買了一把烏克麗麗,卻無法入門嗎? 您知道吉他譜不適合學烏克麗麗嗎? 上網學烏克麗麗,影片卻看不清楚嗎? 買了烏克麗麗書籍打算自學,卻發現沒有真人親身示範? 這是第一本專門為烏克麗麗所設計的學習書~ 讓你從「

生日快樂」到「淚光閃閃」, 從「李大仁之歌」到「Crazy G」, 從調音開始,一步一步帶著你學會烏克麗麗, 相信自己!你也能彈出「卡農」! Aguiter老師藉由分享多年來教學的心得,從完全不會彈到知道怎麼彈的同學心態寫起,試著用親切的方式,讓同學們簡單而純粹得到演奏音樂所帶來的幸福與快樂! 準備好彈奏開心的烏克麗麗了嗎?同學們,一起來吧!!! Aguiter老師明白,烏克麗麗新手一顆單純想學音樂的心! 親切易懂的教學方式,挑選專門烏克麗麗彈奏的歌曲。 8堂課完全學會烏克麗麗獨奏、自彈自唱、演奏三大技巧! 十數年任教於學校、社團、醫學中心、教會經驗的Ag

uiter郭志明老師,嘔心瀝血錄製DVD影音,完全親身示範書中曲譜,讓你對照書本、看著影片就可以學會烏克麗麗,立刻上手演奏! 保證只要書裡有的,影片也絕對仔細教你! 有了這本書,不再當烏克麗麗孤兒~

am吉他譜進入發燒排行的影片

#琳誼偷偷唱個搶先聽給大家聽

#蚵仔麵線吉他譜

歡迎大家Cover~

G G Am D

前奏

G Em

蚵仔跟麵線 一個愛藏水 一個愛日頭曬乾

C D

生活不相同 想不到結果變得這麼密

G Em

親相你跟我 本來不認識 現在鬥陣底這

C D

你想要聽歌 我就彈吉他 唱歌給你聽

G D/#F

我跟你就親像是蚵仔麵線

Em Dm G7

無味的人生若是有你就香

C Bm Em

我若覺得孤單 都有你陪我

Am D

原來歡喜是這麼簡單

G D/#F

我跟你就親像是蚵仔麵線

Em Dm G7

無味的人生若是有你就香

C Bm Em

現在我才知道 我不是一個人

Am D G

有蚵仔就有麵線

#琳誼Ring01 #俗女養成記2插曲 #蚵仔麵線

小提琴設計製造之輔助工具模組及技術發展

為了解決am吉他譜 的問題,作者蘇秉翔 這樣論述:

小提琴製作方法主要是藉由經驗傳承,或透過試誤法方式理解如何製作一把好的小提琴,由於,小提琴的聲音和振動是優質小提琴的關鍵,因此需針對小提琴發聲機制進行探討,探討方式可經由實驗模態分析(experimental modal analysis, EMA)與有限元素分析(finite element analysis, FEA),進行FEA時,機械性質是影響分析結果的關鍵之一,為了取得小提琴機械性質,因此需進行小提琴素材機械性質測定,會透過小提琴素材模型驗證(model verification, MV)。模型驗證進行模態分析、簡諧響應分析及最佳化分析,其過程單一且重複性高,因此本文建立矩形平板自

動化分析模組,可有效及有效率的進行模型驗證,並取得小提琴素材機械性質。接著透過FEA建立小提琴分析模型,探討小提琴發聲機制,透過純結構系統分析,和考量空氣因素的結構與空氣耦合系統,進行模態分析與簡諧響應分析,結果顯示,在低於500Hz的聲音頻譜,主要受到小提琴音箱腔體模態影響,而高於500Hz的聲音頻譜,主要受小提琴結構彈性體模態所貢獻。而小提琴的聲音振動探討,也可透過實驗量測,但實驗檔案數量都多,導致後續分析效率低,因此提出聲音振動量測分析SOP,以及自動化後處理分析模組,透過檔案管理系統以及聲音品質指標分析模組,可以快速進行實驗檔案分類,並呈現出時間域訊號及頻率域訊號,快速進行分析探討。並

透過自動抓取聲音頻譜峰值參數功能,可計算頻譜質心的客觀聲音指標,以界定聲音的宏亮度;最後建立聲音重建模組,透過理論解析方式,可獲得聲音特徵,包含音色參數與時間參數,並進行聲音重建。本文所建立的矩形平板自動化分析模組,可快速取得小提琴素材機械性質,並提出音場分析技術,透過理論分析探討小提琴發聲機制,並建立聲音重建模組,進行聲音重建。同時,本文所建立自動化分析模組與音場技術發展也適用於其他結構。

烏克知音 (上)

為了解決am吉他譜 的問題,作者陳加容 這樣論述:

你想快速學會烏克麗麗?( •́ _ •̀) ? 還是..快樂學烏克麗麗(ノ>ω 很多人開始彈烏克麗麗就是因為它簡單好學,也因為如此,很多教本都標榜快速學習,但是只追求快速學會的結果,就是各方面都囫圇吞棗學不好。雖然很快就學了一首歌,卻沒有學會樂譜怎麼看,拍子怎麼數,和絃怎樣換,長期下來,不僅基礎不扎實,實際進度慢,遭遇的學習瓶頸還會多到讓學生想放棄! 學烏克有更好的方法!(✪ω✪) 如果學烏克能循序漸進,從最簡單的和絃、節奏和旋律開始,學好基礎的樂理和讀譜的技巧以後,再加上其他和絃及節奏變化,這樣不僅能打好扎實的基礎,以後學習其他的歌曲甚至轉換樂器也都能快速上手

。這就是烏克知音最重要的基礎概念。 ☆烏克知音 一本循序漸進又兼顧彈奏樂趣的好教材 烏克知音是特別針對音樂初學者設計的教材,內容包含豐富的知識和樂理常識,不僅在歌曲旋律、節奏及和絃各方面都循序漸進,每一個學習階段和單元也安排了大量歌曲,遇到新的節奏及和絃還有各種小練習幫助你更快進入狀況。而且收錄的歌曲旋律也特別為烏克量身打造,每一首歌曲的旋律都可以用烏克麗麗彈奏,不用怕音域太低無法彈,或音域太高音不夠。 本書特色 ☆循序漸進的節奏安排 烏克知音從一拍、兩拍、三拍、四拍等最容易數的節奏開始,再慢慢導入比較困難的附點、半拍和四分之一拍。學好各種拍子的數法,當然就不需要再

痛苦的跟著音樂一句句模仿了。 ☆由簡入繁的和絃教學 彈一首歌要學好幾個新和絃,按都按不好了,還要換來換去,對初學者來說真是痛苦又麻煩。如果能用好幾首歌來學一個新和絃,那不就輕鬆多了? 烏克知音從最常用的基礎和絃開始,每教一個新和絃都安排了很多首歌曲可供練習,熟練以後再學新和絃,就能輕鬆上手。 ☆好彈好唱、獨奏合奏都超棒 除了可以刷奏和撥奏以外,本書所有歌曲的旋律都可以使用21吋的烏克麗麗彈奏,即使用最入門的彩琴,也沒有音域不夠的問題。大多數的歌詞都經過精心設計編寫,簡單易唱而且押韻順暢。歌曲也搭配有各種刷奏和撥奏節奏型,學生能開心的自彈自唱,或者跟朋友合奏,用來上團

體課效果也非常好。 ☆五線譜、簡譜、TAB譜三譜並列,輕鬆學看譜,不再霧煞煞 學古典音樂的人習慣五線譜,學流行音樂的喜歡看簡譜,彈吉他的人愛看TAB譜,沒問題!烏克知音所有的歌曲都採用三譜並列的方式,不管學過什麼樣的樂器,在烏克知音裡一定能找到習慣看的譜,還能透過對照方式學習讀新的樂譜。而且烏克知音TAB譜採用附有節奏符桿的專業寫法,往後要改彈吉他,也能馬上適應。 ☆線上影音示範,隨時隨地,想看就看 不知道這首歌怎麼彈嗎?沒問題,老師馬上彈給你看! 不要再辛苦的到處找CD機!打開手機,掃描QR code,馬上就能聽到示範演奏。想要聽旋律邊刷邊唱?要演出沒人彈伴奏?打

開手機,刷個QR code,有網路的地方,就隨時能學習,隨時都可以輕鬆演奏!

基於深度學習的MIDI生成器之研究與實作

為了解決am吉他譜 的問題,作者劉翼翬 這樣論述:

人工智慧(artificail intelligence, AI)自早期的機器學習法、類神經網路、專家系統,到現在所產生的深度學習,一路上經歷了不少變革,現在影像辨識與應用在卷積神經網路(convolutional neural networks, CNN)的研究下越來越成熟。深度學習(Deep learning)技術於2016年起開始蓬勃發展,深度學習圖像辨識的技術與應用已非常的成熟,從臉部辨識到智能美型等功能,而知名社群網站Facebook也使用上億張的圖片以訓練其AI機器人Lumos,識別圖片中的物件更可從圖片中的元素找出其中的關聯性。另一方面,Facebook旗下一款免費提供線上圖

片與視訊分享的社群應用軟體Instagram亦可以利用其功能—主題標籤(Hashtag)找到許多具有同樣Hashtag名稱的相關圖片,當大量擁有相同的Hashtag時,AI可直接從給予的圖片中標記出Hashtag。除了Facebook外,Google、百度、亞馬遜公司(Amazon)…等各個著名企業,也正積極努力開發各種AI圖像辨識的功能。相較於影像,聲音的研究成果與數量就稍微遜色,目前有關聲音AI研究與應用例如:Lyrebird AI利用使用者錄製的讀稿語音,經過學習產生樣本,最後使用者可以運用自己所錄製的語音作為發聲源,讀出所擬之文稿,但目前以英語為主,尚未取樣中文的功能;Bach Doo

dle將使用者輸入的旋律經過調和,將其轉為巴洛克時期音樂家巴哈風格的音樂;Pixel Player透過觀看大量未經過標記的音樂影片進行學習,透過發聲的音源進行定位,試著了解畫面中的樂器(小提琴、吉他、低音號等)如何移動,最後將音源分離。綜合以上,聲音的應用雖較為少見,但聲音的AI應用將成為未來趨勢,以現在的深度學習機制,許多具有極大潛能的技術都有望被開發。目前聲音AI鮮少可以直接應用於生活中的作品,完成度不夠理想,故本次研究目的為使用樂器數位介面(Musical Instrument Digital Interface,MIDI)的資料給予機器進行學習,使之產生與參考音樂相似且具音樂性的音樂,

MIDI生成使用自製資料集BBCDV資料集,此資料集由貝多芬、拜爾德、蕭邦、德布希與韋瓦第共五位作曲家的創作所組成,每位作曲家挑選十首音樂作品,並將每首歌曲轉為同一速度、同一調性,每個音符力度設為相同的數值,統一將音符輸出為相同的鋼琴音色,將作曲家樂曲之MIDI以卷積神經網路(convolutional neural networks, CNN)為基礎架構的殘差密集網路(residual dense network,RDN),使用RDN中的殘差密集模組(redidual dense blocks, RDBs),提取其特徵,並給予機器進行訓練,生成與資料集音樂相似之MIDI,透過人工方式將產生的

MIDI訊號轉為波形音訊(waveform audio, Wav),再將wav檔案轉為mp3檔案,利用ID3 tag的標籤,將每首歌手動標記風格分類,mp3取梅爾倒頻譜係數(Mel-Frequency Cepstral Coefficients, MFCCs)將其圖像化為梅爾倒頻譜(Mel-Frequency Cepstrum,MFC),將每首歌頻譜圖分割為數個切片,使用CNN架構提取每個音樂切片的特徵,並依ID3 tag內所標記的音樂風格,放入與其風格標籤相同的資料夾中,將所有分類好的音樂進行訓練,最後將資料集中參考樂曲的MIDI與使用AI機器學習生成樂曲的MIDI,將其放入風格辨識機,查看

經過風格辨識學習的機器是否能給予音樂正確的風格標籤。以音樂創作的角度切入,觀察研究是否能對音樂創作能產生幫助,從中產生的音樂素材是否能夠加以運用。