對比英文的問題,我們搜遍了碩博士論文和台灣出版的書籍,推薦(英)喬納森·馬克斯寫的 劍橋國際英語語音在用:初級(修訂版)(全三冊) 可以從中找到所需的評價。

另外網站中英文語法對比:基本辭彙、邏輯、語氣之差別也說明:辭彙操作特質:. 中文辭彙:沒有形態變化,主要靠詞語、順序以及內在的邏輯關係來表達句子的含意. 英文辭彙:形態變化豐富(例如名詞有number和case的變化,動詞有人 ...

國立中央大學 資訊管理學系 薛義誠所指導 鍾文翔的 新聞導言之智能生成 (2019),提出對比英文關鍵因素是什麼,來自於新聞導言、事件提取、5w1h、TextRank、Word2Vec。

而第二篇論文國立交通大學 管理學院資訊管理學程 黃興進、古政元所指導 吳冠陞的 使用序列到序列架構建立之自動文本摘要-以中文文本為例 (2018),提出因為有 自動文本摘要、序列到序列、循環神經網路的重點而找出了 對比英文的解答。

最後網站【每日必看】"反萊豬公投"一定過?!柯文哲轟小英 - Tnews.cc則補充:柯文哲轟小英:讓人精神錯亂@中天新聞20211118公投#柯文哲#反萊豬#蔡英文#萊牛#美豬#中天新聞年底公投決戰,台北市長柯文哲斷言,反萊豬公投一定會過關!柯文哲還說,他對比 ...

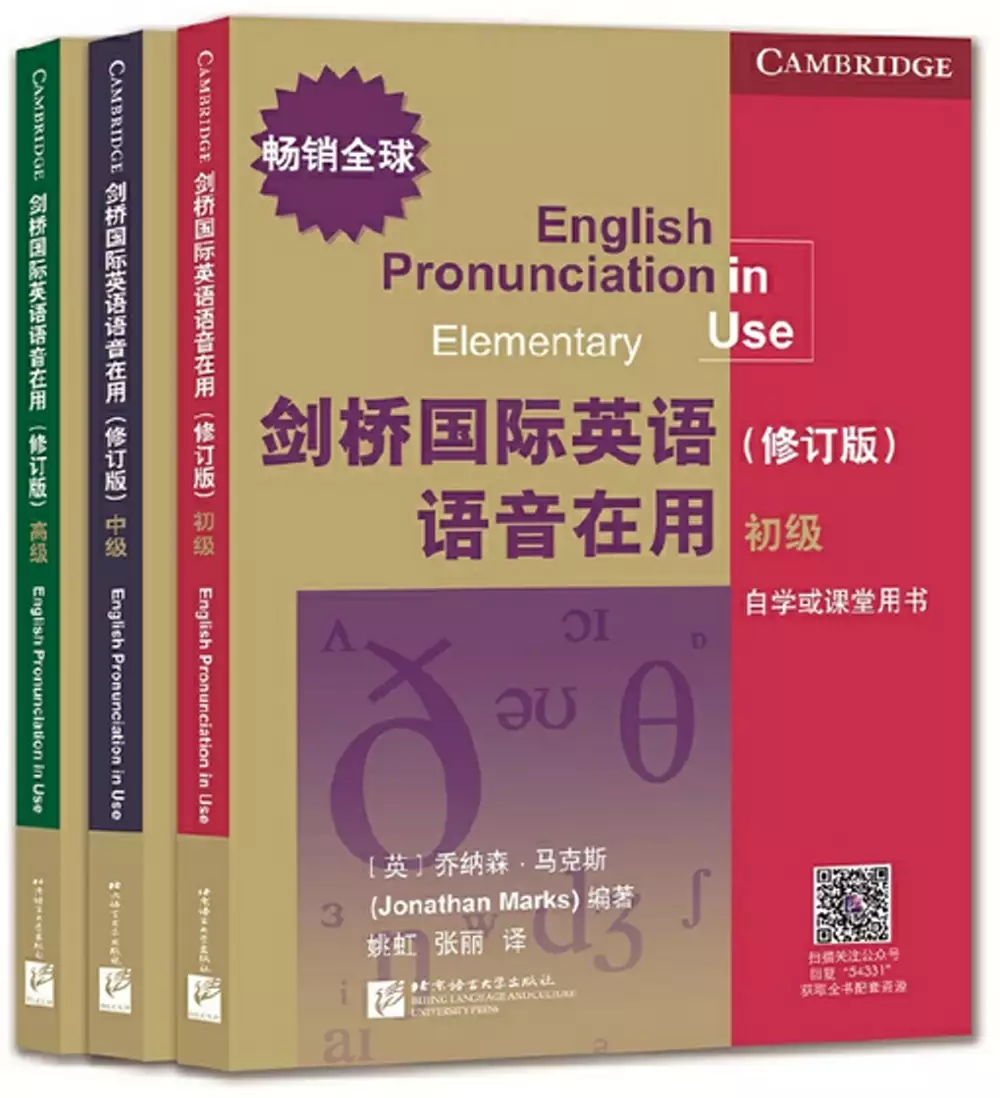

劍橋國際英語語音在用:初級(修訂版)(全三冊)

為了解決對比英文 的問題,作者(英)喬納森·馬克斯 這樣論述:

本套教材包含三個級別:初級、中級、高級。這三個級別的內容自成體系而深度逐漸增加。每個級別劃分為若干單元,每個單元都側重不同的語音要點。每個單元共有兩頁,左頁是講解和舉例,右頁是相應的練習。 初級的50個單元分為四個部分:第一部分(SectionA)講解英語中42個音素的發音及拼寫;第二部分(SectionB)講解單詞中的音節和重音;第三部分(SectionC)講解短語、句子和語法,涉及連讀、節奏、強讀和弱讀、縮略式等語音知識;第四部分(SectionD)主要講解實際對話中的語調。第五部分(SectionE)是一些實用的語音學習參考資料,內容包括:音標表、各種語言使用者的發音指南、音素對比、英

文字母、數位的讀法、地名的發音、同音詞等。書末附有各個單元練習的參考答案。 中級的60個單元劃分為三個部分:第一部分(SectionA)講解單個音素的發音及拼寫;第二部分(SectionB)講解單詞和句子中的語音;第三部分(SectionC)講解對話中的語音。第四部分(SectionD)包括音標介紹、語音測試、各種語言使用者的發音指南、音素對比、日常用語中的句子重音、術語表。書末附有練習參考答案。 高級的60個單元分為四個部分:第一部分(SectionA)介紹不同英語變體的口音、自學語音時可用的資源,以及慢速口語和快速口語之間的語音區別;第二部分(SectionB)介紹單詞和短語的發音,內

容涉及輔音連綴、重讀音節和非重讀音節,以及外來詞的發音;第三部分(SectionC)介紹對話中的語音,內容涉及流利口語的特點、語調如何影響語義;第四部分(SectionD)介紹正式場合中的語音,如商務報告、會議發言等。第五部分(SectionE)包含如下內容:音標的練習、輔音連綴的擴展練習、單詞重音的擴展練習、術語表、補充閱讀資料等。書末附有練習參考答案。 修訂版與第一版的區別: 內容:框架結構沒有改變,但對內容進行了修訂,文字的準確性、表達的專業性、參考答案的正確性都有全面提升。 設計:充分利用專色突出顯示音標、示例、重點內容、對比資訊、參考答案等,使用更加方便。

[英]喬納森·馬克斯(Jonathan Marks)、[英]馬克·漢考克(Mark Hancock)、[英]馬丁·休因斯(Martin Hewings),英國著名語音學家,語言教育家。曾著有暢銷全球的English Pronunciation in Use等作品。

對比英文進入發燒排行的影片

🇬🇧你懂英式幽默的笑點嗎?

今天的影片我想帶大家一起來看英國人常看的脫口秀 The Graham Norton Show,👂聽懂英國腔同時了解英式幽默的笑點,也幫助你更了解英國文化喔!

🔔 我正在使用的 VPN 服務:Surfshark VPN ► https://bit.ly/2Wh0eKf

(現在點擊連結 輸入優惠碼 SUSIEWOO 即可享有 3個月免費試用 以及 1.7折的優惠價喔! 🦈)

🎞️原版脫口秀影片 Try Not To Laugh on The Graham Norton Show | Part Seven ►

https://www.youtube.com/watch?v=vwW7hOE30rs

📣備註。 影片中提到的我們在英國學到 "我們不會成功" 是一個感覺,不是我們的父母這樣教導我們,而我認為可能的原因有:

1. 戰爭,英國長期的歷史中,戰爭造成一定的創傷,老一輩的英國人有很典型的 'stiff upper lip' ,類似控制情緒的意思,尤其面對負面的事情時。

2. 有人會說在過去樂觀且勇敢的人會選擇移居去美國,而留在英國的人相對比較容易擔憂以及孤僻。

📧合作相關訊息請郵寄至 [email protected]

📌點擊了解更多 Susie 的英文線上課程 ► https://www.susiewoo.com

📌點擊加入 Susie 的線上英語課程訂閱計畫 ► https://www.susiewoo.com/zhtc-susie-subscription

- - - - - - - - - - - - - - - - - - - - - - - -

加入 Susie Woo 戴舒萱 的 YouTube頻道會員:

https://www.youtube.com/channel/UC-IQGcGol7OOCH2B2Z8dUag/join

與我一起用英文討論不同議題,讓我聽見你的聲音。

- - - - - - - - - - - - - - - - - - - - - - - -

關注我的IG

► https://www.instagram.com/susiewooenglish

支持我製作更好的內容

►https://www.patreon.com/susiewoo

Clubhouse

► @susiewoo

Bilibili (B站)

► https://space.bilibili.com/696608344

#英式幽默 #脫口秀 #英式英文

新聞導言之智能生成

為了解決對比英文 的問題,作者鍾文翔 這樣論述:

新聞導言是新聞內容中相當重要的一部分,導言處在新聞的開頭,以最簡練的文字寫出文章中的重點內容,吸引讀者繼續看完整篇報導,導言主要可分為硬式新聞導言及軟式新聞導言兩種大類,硬式導言的內容通常包含新聞的何時(when)、何地(where)、何事(what)、何人(who)、為何(why)、如何(how),簡稱5w1h,要求在簡短的篇幅盡可能描述新文的主體;軟式導言則偏向使用新奇、懸疑的手法來吸引讀者興趣。但目前的自然語言處理任務中,生成新聞標題、新聞摘要的相關研究相當多,自動產生導言的研究卻較少。本研究主要在建立一套自動產生導言的框架,從導言本身的寫作手法和要素去分析,利用TextRank結合W

ord2Vec與句子位置、句子長度、標題重疊率去辨識新聞關鍵事件,取得主題句子集合,再將句子集合去進行詞性標注、命名實體、語義角色標注等方式來抽取新聞5w1h要素,然後分別產生硬式新聞導言和軟式新聞導言。硬式新聞導言抽取七種常見硬式新聞導言類型,即敘事式、描寫式、引語式、描寫式、提問式、評議式、結論式、對比式的特徵,例如:研究結果、地點描述、提問、引用句等,最後將5w1h要素及導言特徵兩者結合去產生硬式新聞導言。軟式新聞導言的部分,使用隱藏5w1h要素的句法來產生懸疑手法,成功產生了軟式新聞導言。依照這些方式,本研究產生了硬式新聞導言及軟式新聞導言,確保產生的新聞導言包含足夠的新聞重點資訊,且

能依使用者需求產生不同類型的導言。本研究除了能幫助使用者減少撰寫導言的人力及時間需求,更使產生出來的導言有著多樣的寫作風格,可依照使用者的需求做改變,產生的導言也能讓讀者快速瞭解到新聞資訊。

使用序列到序列架構建立之自動文本摘要-以中文文本為例

為了解決對比英文 的問題,作者吳冠陞 這樣論述:

在現今資訊爆炸的時代中,人們會想要在最短的時間從大量的文本中擷取重點資料,而如何快速的篩選出需要的資訊就是一門重要的議題,自動文本摘要(Automatic Text Summarization)是其中一種合適的選擇,而在生活中常用的中文卻在此技術上發展緩慢,本研究針對中文的自然語言處理(Natural Language Processing, NLP)開始研究並使用現有的雙向(Bidirectional)與單向(Unidirectional)循環神經網路(Recurrent Neural Network)組成序列到序列(Sequence to Sequence)架構,並搭配注意力(Atten

tion)機制與詞向量(Word Vectors)訓練多個不同參數的抽象式自動文本摘要模型,並且搭配集束搜索(Beam Search)與貪婪搜索(Greedy Search)在選字階段做比較,再使用召回率導向的摘要評估(Recall-Oriented Understudy for Gisting Evaluation, ROUGE)來比對自動文本摘要與人工摘要的分數,而實驗中比較出分數最高,摘要能力最好的是向量維度為500維,搭配512層雙向循環神經網路並使用集束寬度為2的集束搜索法所組合之模型,而在實驗中也發現新聞格式的中文文本,在選用貪婪搜索與集束寬度為2的集束搜索會有較好的平均分數與摘要

能力。

對比英文的網路口碑排行榜

-

#1.e悅讀學校計劃 - 香港閱讀城

高對比主目錄. 請使用學生、學校教師或職員帳戶登入。 按閱讀組合瀏覽:. 全部; 英文經典系列(彈性版面); 中國古典名著系列(文字同步朗讀) 於 www.hkreadingcity.net -

#2.高端打不完只能銷毀洪孟楷怒問陳時中這一句| 政治新聞

... 而陳時中部長在回覆立委質詢時所說「打不完只能銷毀」,對比三個禮拜前一樣在 ... 蔡英文總統主持鳳松、鳳誠安居社宅動土陳其邁:打造高雄安居、. 於 m.match.net.tw -

#3.中英文語法對比:基本辭彙、邏輯、語氣之差別

辭彙操作特質:. 中文辭彙:沒有形態變化,主要靠詞語、順序以及內在的邏輯關係來表達句子的含意. 英文辭彙:形態變化豐富(例如名詞有number和case的變化,動詞有人 ... 於 sex.ncu.edu.tw -

#4.【每日必看】"反萊豬公投"一定過?!柯文哲轟小英 - Tnews.cc

柯文哲轟小英:讓人精神錯亂@中天新聞20211118公投#柯文哲#反萊豬#蔡英文#萊牛#美豬#中天新聞年底公投決戰,台北市長柯文哲斷言,反萊豬公投一定會過關!柯文哲還說,他對比 ... 於 tnews.cc -

#5.大膽說出你的破英文- Contrast使用在懸殊差異的對比 - Facebook

*contrast對比,對照;(對照之下形成的)懸殊差別*comparison比較,對照;類似;比喻*dramatically戲劇性地; ... 大膽說出你的破英文, profile picture. 於 www.facebook.com -

#6.對比英文詩歌選The Contrast English Poetry in Song SACD2413

庫存少量,可能缺貨。請聊聊詢問庫存** 專輯類型: 1SACD 發行年份: 2020 國際條碼: 7318599924137 音樂廠牌: BIS 對比(英文詩歌選) 卡洛琳.桑普森女高音喬瑟夫. 於 shopee.tw -

#7.說一句英文讓人記住你

讓人記得住,就有特色。 來看一個例子:「No business too small, no problem too big.」這是IBM的slogan。IBM用簡單兩組對比 ... 於 www.businessweekly.com.tw -

#8.蔡英文慰問中國鄭州災情蔡正元揭對比:這一次做對了| 風傳媒

前國民黨立委蔡正元22日表示,總統蔡英文對中國河南鄭州水災表達關切一事,「這一次做對了!」(資料照,顏麟宇攝). 中國河南省鄭州等地連日受暴雨 ... 於 today.line.me -

#9.對比的英文翻譯 - 字典

比的英文翻譯“對比”的日文翻譯對比拼音:duì bǐ 英文解釋:balance; contrast; parallel; ratio【計】 matching【醫】 contrast【經】 comparison中文解釋:(1) ... 於 www.70thvictory.com.tw -

#10.對比英文完整相關資訊

YouTube王菲兩個女兒對比,同媽不同爸命運大不同,倆人顏值差別非一般大,一個在貴族學校上學,另一個坐電動車吃路邊攤· 明星周刊... 台語新歌排行榜taiwan music. 於 digitalsolute.com -

#11.英語19種修辭手法的全部解釋和例句- 英語相關新聞

明喻是將具有共性的不同事物作對比。 ... 英文解釋:an expressive style that uses fictional characters and events to describe some subject by ... 於 www.english.com.tw -

#12.比较英文怎么说,比较英文用法解析 - iBS外语学院

比较英文怎么说,比较英文用法解析 · 1.compare to 比作. compare to 的中文意思更贴近「比作」,当我们说Compare A to B 的时候,实际上是把A比作B。 · 2. 於 www.zhibs.net -

#13.網民分享香港人英文差而鬧出的笑話!港式英語成主因?小學時 ...

香港一在2020年英孚英語程度指數(EF EPI)報告中排33位,對比2017年的排名29位似乎有下跌趨勢。最近,有網民分享日常生活中見過香港人英文最差既時候 ... 於 www.gotrip.hk -

#14.中文常用詞句及中英對比與翻譯, 第三輯 (繁體版)

這樣,具有一定英文水平的學習者,在大量中英典型例句對比和翻譯的實踐過程中,就能趣味盎然地學到中文的精髓,同時也找到中英互譯的竅門,而他們的英文水平 ... 於 books.google.com.tw -

#15.大學重考3 次、創業瀕臨破產,卻靠販賣機驚艷台灣、勇闖國際

聯考重考3 次、英文只有9 分、大公司不錄取的Duncan,透過創業證明:無論 ... 不優渥的經濟條件下學英文,看著課堂上的韓國學生們「倒頭就睡」,對比 ... 於 crossing.cw.com.tw -

#16.''反萊豬公投''一定過?!柯文哲轟小英 - 中視

年底公投決戰,台北市長柯文哲斷言反萊豬公投一定會過關!柯文哲還說他對比蔡英文過去反對萊牛的言論,如今卻全力護航萊豬,他嗆蔡英文簡直讓人精神 ... 於 new.ctv.com.tw -

#17.快新聞/蕭美琴ALEC流利英文演說在台灣發推特不會被抓去關 ...

快新聞/蕭美琴ALEC流利英文演說在台灣發推特不會被抓去關對比中國獲熱烈掌聲-民視新聞. Share This Content. AddThis Sharing Buttons. 於 www.mti.edu.eg -

#18.如何用英文表達對比,你可以這樣說! - 希平方

如何用英文表達對比,你可以這樣說! · while 然而. 我們很常用while 來表達「當... · whereas 反之、卻、而 · however / nonetheless / nevertheless 然而. 於 www.hopenglish.com -

#19.城中城大火公祭蔡英文快閃2分鐘羅智強對比馬英九轟「何其 ...

不過台北市議員羅智強批評,蔡英文僅僅快閃2分鐘,而民進黨上下還只關心怎麼挺「肇逃仔」,相當冷血。他也將此事對比2013年洪仲丘事件時前總統馬英九 ... 於 www.storm.mg -

#20.形成鲜明对比-翻译为英语-例句中文 - Context Reverso

使用Reverso Context: 网眼衬里与顶部形成鲜明对比,在中文-英语情境中翻译"形成鲜明对比" 於 context.reverso.net -

#21.DeepL翻译:全世界最准确的翻译

即使谷歌(Google)和微软(Microsoft)的英文翻译效果相当不错,但DeepL的翻译表现还是超过了它们。我们翻译了一份法国日报的报道,DeepL的结果堪称完美。Golem.de 於 www.deepl.com -

#22.比较文学- 维基百科,自由的百科全书

比较文学(英語:comparative literature,法語:littérature comparée),有时也称世界文学,是一个融会贯通多学科、多语言、多文化的学术领域。 於 zh.wikipedia.org -

#23.實用的過渡詞| EF English Live 部落格

適當的使用過渡詞,可以幫助人們在各種情況下更好的表達自己,讓讀者或聽者理解你想要傳遞的訊息。 過渡詞有順序、强調、對比、總結等多種類型。在線上英文學習,我們將爲 ... 於 englishlive.ef.com -

#24.「對比於英文」+1 你真的分的清楚嗎?on the contrary - 藥師家

在學術英文寫作,常常會需要做兩個觀點的正反面比較,或是提出另外一種... In contrast 和by contrast 意義相同,都是用來對比兩件事或兩個人之 ...,沪江英语词库精选 ... 於 pharmknow.com -

#25.与去年同期相比”的英文说法有哪些? - Will的美语课

在日常生活及工作中,我们常常需要将某些数据和“去年同期”的数据进行对比,以更好地对情况进行分析、判断。英文中,去年同期、与去年同期相比的说法有 ... 於 www.learnenglishwithwill.com -

#26.今昔對比英文完整相關資訊 - 星娛樂頭條

上萬部YouTube影片教材,搭配中英文翻譯字幕與英漢字典,輕鬆掌握日常對話、瞭解單字的發音與用法。 是最適合華人 ...【英文文法】2019 英文作文必備實用連接詞大全,寫作 ... 於 gspentertainment.com -

#27.蔡英文就是初音未來?網曬對比圖揭「2人特殊關係」:邏輯正確

〔即時新聞/綜合報導〕今(31日)為總統蔡英文及虛擬歌手初音未來的生日,對此,臉書粉專「台灣迷因」特地做出對比圖,沒想到2人竟有多個相同之處, ... 於 ent.ltn.com.tw -

#28.教專研098P-047 中英否定式對比與教學應用98-561 通識中心

本文利用對比. 分析法對比中英文的句式差異,由形式與語義的搭配關係說明英文否定句式的表達方式. 及其與中文表達方式的差異,希望能幫助學習者釐清並理解英語獨特的否定 ... 於 web.nanya.edu.tw -

#29.對比中英文詞彙的過去和現在 - 太易資訊

中文是平面和圖形化的方塊字,英文則是線性拼音文字,結構本質和表現方式完全不同,基本上,中文字比較是視覺化的,英文比較是語音化的。 在以往,中文和英文對比, ... 於 www.dayi.com -

#30.contrast中文(繁體)翻譯:劍橋詞典

I like the contrast of the white trousers with the black jacket. 我喜歡白色長褲與黑色外套形成的對比。 The antique furnishing provides an unusual contrast to the ... 於 dictionary.cambridge.org -

#31.中英文對比修辭

Title: 中英文對比修辭. Contrastive Rhetoric. Other Titles: 閱讀與教學之研究. Impacts on Efl Reading and Its Classroom Application. 於 rportal.lib.ntnu.edu.tw -

#32.表示事物的对比,可以有哪些花式英文表达? - 知乎专栏

这里顺便总结一下其他表示对比的英文单词或词组,方便大家日后在翻译或写作中替换使用,不重样。部分例句选自往期经济学人文章。 最简单的比较,不突出 ... 於 zhuanlan.zhihu.com -

#33.達觀數據:中文對比英文自然語言處理NLP的區別綜述 - 台部落

人工智能時代,讓計算機自動化進行文字語義理解非常重要,廣泛應用於社會的方方面面,而語言本身的複雜性又給計算機技術帶來了很大的挑戰,攻克文本語義對 ... 於 www.twblogs.net -

#34.總統大選哪位候選人贏面更高?民調結果顯示侯友宜小幅領先 ...

... 正打得不可開交之際,蔡英文總統及朱立倫主席,則對黨內下達軍令狀, ... 候選人;而台灣清新3.1連線執行顧問黃薪哲也表示,民調為對比式有效民 ... 於 news.sina.com.tw -

#35.對比英文完整相關資訊 - 輕鬆健身去

提供對比英文相關文章,想要了解更多對比例句、對比例子、對比英文有關運動與健身文章或書籍,歡迎來輕鬆健身去提供您完整相關訊息. 於 fitnesssource1.com -

#36.對比(英文詩歌選) / 卡洛琳.桑普森女高音/ 喬瑟夫.米道頓鋼琴 ...

對比 (英文詩歌選) / 卡洛琳.桑普森女高音/ 喬瑟夫.米道頓鋼琴(SACD). The Contrast – English Poetry in Song / Carolyn Sampson (SACD). 於 www.books.com.tw -

#37.對比英文-新人首單立減十元-2021年11月|淘寶海外

去哪儿购买對比英文?当然来淘宝海外,淘宝当前有347件對比英文相关的商品在售。 在这些對比英文的書法字體有英文、行書、楷書、數字和草書等多种,在對比英文的適用 ... 於 world.taobao.com -

#38.顏色對比、色彩對比英文,color contrast中文 - 三度漢語網

中文詞彙 英文翻譯 出處/學術領域 顏色對比;色彩對比 color contrast 【心理學名詞‑兩岸心理學名詞 】 顏色對比、色彩對比 color contrast 【心理學名詞】 相對色彩;對比色彩 relative hue 【電機工程】 於 www.3du.tw -

#39.對比是什麼意思、英文翻譯及中文解釋

對比 是什麼意思、英文翻譯及中文解釋簡介:對比詞語:對比解釋:contrast詞典:消防專業漢英詞典對比相關解釋contrast〔名詞〕差異, ... 於 m.yydjb.com -

#40.'对比' 的英语Translation | 柯林斯汉语- 英语词典 - Collins ...

'对比' 的英语Translation of | 官方柯林斯汉语- 英语词典网上词典。10 万条简体中文单词和短语的英语翻译。 ... 学习资源. 对比的翻译—— 柯林斯中文到英文词典 ... 於 www.collinsdictionary.com -

#41.A contrast quite markedly with B. A与B形成相当明显的反差 ...

用这个句型结构将中文句子翻译成英文 句子1: 城市生活与乡村生活形成相当明显的反差 ... 解释:对比几种同类事物的异同、高下。 例1:A be more common than B. A比B更 ... 於 www.langlib.com -

#42.對比英文怎麼說 - 查查在線詞典

對比英文 翻譯: [ duìbǐ ] 1.(相對比較) contrast; comparison;…,點擊查查綫上辭典詳細解釋對比英文發音,英文單字,怎麽用英語翻譯對比,對比的英語例句用法和解釋。 於 tw.ichacha.net -

#43.蔡英文說法昔今對比柯文哲:天啊是同一個人嗎?

台北市長柯文哲接受網路節目專訪今天播出。對於萊豬大戰,柯文哲再嗆,最受不了藍綠兩黨,每個都靈魂交換。柯也說,蔡英文201... 於 udn.com -

#44.对比的英文怎么说 - 沪江网校

沪江英语词库精选对比英文怎么写、对比用英语怎么说及怎么读、对比的英文怎么说、对比的英语读音及例句。 於 www.hujiang.com -

#45.英漢對比修辭與英文寫作

Connection between contrastive rhetoric and English writing. A. Writing is an activity embedded in a culture. 於 www.lttc.ntu.edu.tw -

#46.對比是什麼意思,對比的解釋反義詞近義詞英文翻譯-國語詞典

[對比]詳細解釋 · 把兩種不同的事物或情況互相比較。 郁達夫《花塢》:“但泥牆傾圮,蛛網繞樑,與壁上掛在那裡的字畫屏條一對比,極自然地令人生出了'俯仰之間,已成陳跡'的 ... 於 iccie.tw -

#47.相反對比 - 余老師英文作文教室

In contrast, On the other hand, On the contrary. ~表示「相反、對比」的用法~. ☆ 解析:. on the contrary(恰恰相反、相反地). 用來表示與剛才講的相反或極不 ... 於 www.iwriteonline.tw -

#48.亮度對比- 教育百科

開啟詞條名稱:亮度對比QRcode分享. 切換來源 ... 英文:. brightness contrast. 日期:. 2003年10月. 出處:. 測繪學辭典. 辭書內容 ... 國家教育研究院_亮度對比. 於 pedia.cloud.edu.tw -

#49.对比语言学导论(英文版21世纪英语专业系列教材) - Amazon.com

本书是国内第一部用英文撰写的语言共时对比研究著作,对于语言学、翻译学和外语教学等领域内的理论研究而言是一本材料翔实、观点与方法独到的专著,对于高等院校英、汉 ... 於 www.amazon.com -

#50.對比英文完整相關資訊

對比英文 -2021-02-07 | 星星公主2021年2月7日· 【整理】英文履歷修改- 加拿大打工度假攻略-20200917翻譯/ 從中文(繁體) (系統偵測) 翻譯為英文Resume revision? 於 comicck.com -

#51.從對比分析論拉丁文、德文與英文間一些翻譯問題,ERICDATA ...

蔣秦暉,拉丁語、德語與英語同屬印歐語系中年之不同支流。拉丁語雖久已係-「死語」(dead language),但由於其在整個西,ERICDATA高等教育知識庫:兩岸教育學術期刊, ... 於 ericdata.com -

#52.長庚白話醫學專欄-對比劑(Contrast Medium) - 長庚醫院

對比 劑(Contrast medium)是指在醫學影像檢查下所用使用的藥劑。依進入人體的途徑可分為最常見的口服及血管內注射兩種,其目的是增強組織間的對比,提高影像診斷的敏感 ... 於 www1.cgmh.org.tw -

#53.蔡英文美國商會演講影片曝光對比韓國瑜…網友崩潰:太殘忍

有網友撈出蔡英文美國商會演講,並與韓國瑜對比。(圖/翻攝自王定宇臉書粉專影片). 記者黃巈禾/綜合報導. 高雄市長韓國瑜近日出席台北美國商會, ... 於 www.ettoday.net -

#54.3方對比蔡英文民調大勝韓國瑜、柯文哲 - 工商時報

民進黨公布總統初選民調結果,總統蔡英文對比高雄市長韓國瑜、台北市長柯文哲,獲得35.6768%的支持率,高於前行政院長賴清德的27.4843%,在初選民調 ... 於 ctee.com.tw -

#55.請問交叉比對英文要怎麼說 - narkive

如cross-verification, cross-validation, cross-comparison, etc. 注意有些字是另外有意義的,如cross-matching, cross-examination. -- [ ... 於 tw.bbs.lang.english.narkive.com -

#56.亮度對比是什麼意思、英文翻譯及中文解釋- 船舶專業漢英詞典

亮度對比. 詞語: 亮度對比. 解釋: brightness contrast. 詞典: 船舶專業漢英詞典. 亮度對比相關解釋. brightness contrast 〔名詞〕亮度對比. 於 m.smyyj.com -

#57.對比英文用法 - Usyllr

強烈對比的英文翻譯,強烈對比英文怎麽說,怎麽用英語翻譯強烈對比,強烈對比的英文意思,强烈对比的英文,强烈对比meaning in English,強烈對比怎麼讀,发音,例句,用法 ... 於 www.huongmd365.co -

#58.《艾爾登法環》早期概念世界地圖疑似曝光多處對比吻合

發現官方給出的地區是早期藝術概念地圖中,小島與陸地連接的細長的部分。該帳還還表示洩露的地圖中所用的語言是漢字(日本漢字),並把試著它翻譯成了英文 ... 於 playgame.wiki -

#59.英中新词汇对比:英文膨胀无止境,中文不变应万变 - 网易

英中新词汇对比:英文膨胀无止境,中文不变应万变,英语单词,日语,英语,外来词,翻译. 於 www.163.com -

#60.對比英文完整相關資訊

提供對比英文相關文章,想要了解更多對比英文、對比圖、對比例子有關歷史與軍事文章或書籍,歡迎來你不知道的歷史故事提供您完整相關訊息. 於 historyslice.com -

#61.DJI 大疆创新- 官方网站

... RoboMaster TT 创造力套装 · RoboMaster TT 编队飞行套装 · AI 场景化教育解决方案 · 大疆教育平台 · 消费级无人机对比 · OM 系列对比 · Pocket 系列对比. 於 www.dji.com -

#62.“这真是强烈的对比”英文怎么说? - 百度知道

2017-06-28 仔细对比这两幅图可以发现很多这样的例子英文怎么说 1 · 2013-10-17 忍受用英语怎么说??? · 2006-01-12 “这真可笑。”用英语怎么说(比较常用 ... 於 zhidao.baidu.com -

#63.「色調對比」英文翻譯及相關英語詞組- 澳典漢英詞典

色調對比. 1.tonal contrast. 「對比色調」的英文. 1.relative hue. 「對比色」的英文. 1.contrasting colors. 「顏色對比」的英文. 1.color contrast. 於 hanying.odict.net -

#64.元旦談話對比小英憑這點秒殺習近平 - Yahoo奇摩新聞

政治中心/綜合報導總統蔡英文今(1日)在總統府內,以「台灣有你」為題,發表2千多字中、英文內容的元旦談話,而中國國家領導人習近平也在昨晚發表 ... 於 tw.news.yahoo.com -

#65.盧秀燕5天內兩度探視遭毆男大生羅智強喊暖:蔡英文要向她學習

暖心與無恥的對比. 讚 · 回覆 · 標示為垃圾訊息 · 6分鐘. 於 www.chinatimes.com -

#66.對比英文素材PNG_透明背景圖片_向量圖案免费下载 - Pngtree

Pngtree為您提供超過1張免费對比英文PNG圖案素材q去背, PSD設計圖和向量圖。所有對比英文免摳圖設計素材都可以在Pngtree上免費下載。 於 zh.pngtree.com -

#67.對比的英文翻译與發音 - Websaru線上字典

對比英文 翻譯: 對比[duìbǐ] contrastbalanceCL:個|个..., 學習對比發音, 對比例句盡在WebSaru字典。 於 tw.websaru.info -

#68."亮度和對比度"英文 | 螢幕對比英文 - 訂房優惠報報

螢幕對比英文,大家都在找解答。亮度和對比度英文翻譯:brightnell and contrast…,點擊查查權威綫上辭典詳細解釋亮度和對比度英文怎麽說,怎麽用英語翻譯亮度和對比度 ... 於 twagoda.com -

#69.色彩术语的英文描述色相对比、明暗对比、纯度(艳度)对比

色彩术语的英文描述色相对比、明暗对比、纯度(艳度)对比、冷暖对比、补色对比、同时对比、色度对比以及面积对比英文应该怎么翻译?Brightness Contrast应该是明暗对比 ... 於 qb.zuoyebang.com -

#70.陳時中、蔡英文「一年後對比」惹心疼!網淚:這次一起守| 政治

新冠肺炎(COVID-19)2019年年底在中國爆發後,以極快的傳播速率禍害世界各國,而我國因地緣關係,在2020年春節前夕出現了首例確診病患,陳時中也擔任 ... 於 www.setn.com -

#72.視覺同時對比的英文怎麼說 - TerryL

視覺同時對比 的英文怎麼說. 視覺同時對比英文. simultaneous contrast. 視: Ⅰ動詞1. (看) look at 2. (看待) regard; look upon 3. (考察) inspect; watch Ⅱ ... 於 terryl.in -

#73.对比用英语怎么说,对比的英文 - 英语翻译在线翻译

对比 的英语翻译是:comparison...,点击查看详细解释:对比的英文翻译的发音、音标、用法和双语例句等,让你有效掌握这个单词。 於 fy.tingclass.net -

#74.你真的分得清楚嗎?on the contrary, in contrast, on the other ...

在學術英文寫作,常常會需要做兩個觀點的正反面比較,或是提出另外 ... In contrast 和by contrast 意義相同,都是用來對比兩件事或兩個人之不同處。 於 tw.blog.voicetube.com -

#75.【文法懶人包】while的3大用法一次搞懂!

英文 單字「while」是個使用率極高的單字,為什麼呢? ... 英文懶人包~while三大英文用法 ... 的意思,用來表達前後句子的對比,語意近似「but、whereas」. 於 blog.english4u.net -

#76.However、Nevertheless等5個常用英文對比連接詞用法

But用法跟Although用法、Nevertheless用法、However用法及In contrast用法有什麼分別?3分鐘幫你搞清這5個常用的英文比較、對比連接詞,讓你在對比寫作時更加 ... 於 blog.amazingtalker.com -

#77.「compare」正確用法是?compare to, compare with 等的用法!

過在美式英文中常用to,英式英文較喜歡用with,現在則是to 和with 都可以使用喔!例句裡可以看到,compare to/with的中文意思更貼近「比較」或「相比」。 於 english.cool -

#78.「顏色對比英文」懶人包資訊整理 (1) | 蘋果健康咬一口

學術名詞地球科學名詞-天文, color contrast, 色對比. ... 謝謝! ,顏色對比、色彩對比英文怎麼說,颜色对比、色彩对比中文是什麼意思? ,顏色對比;色彩對比英文怎麼說,颜色 ... 於 1applehealth.com -

#79.对比的英文翻译 - 海词词典

海词词典,最权威的学习词典,专业出版对比的英文,对比翻译,对比英语怎么说等详细讲解。海词词典:学习变容易,记忆很深刻。 於 dict.cn -

#80.SOGI手機王- 提供手機價格,手機推薦與比較服務

消光綠新色登場Sony Xperia 1 III與5 III全色系開箱對比. 2021/11/17. 新機情報. #手機 #高通 #Qualcomm #Sony #索尼 #防水手機 #5G手機. 於 www.sogi.com.tw -

#81.contrast - 常用英文單字

對比, 差別, 對照物 v.對比, 成對照 n.[計算機] 反差. 例句與用法:. The coastal areas have mild winters, but by contrast the central plains become extremely ... 於 www.en995.com -

#82.蔡英文國慶演說對比鄧小平版「四個堅持」 汪浩

蔡英文國慶演說對比鄧小平版「四個堅持」 汪浩:台灣中國一邊一國. 新頭殼newtalk | 陳宇芊 台北市報導. 發布2021.10.10 | 19:32 ... 於 newtalk.tw -

#83.【音樂祭踩踏意外】Travis Scott將面臨近30億美元賠償金約140 ...

台灣英文新聞/ 林于雯綜合報導)美國歌手歌手崔維斯史考特(Travis ... 繼續表演的情況呈現對比,讓大量粉絲相當不諒解,在網路上批評Travis Scott。 於 www.taiwannews.com.tw -

#84.形成強烈的對比的英文單字- 英漢例句 - 漢語網

高聳的畫壁同綠色植物形成強烈的對比,與江水的流動合成一種神秘而凝重的氛圍,在陽光或月光下呈現出奇異的色彩。 the paintings on the steep cliffs, the green trees ... 於 www.chinesewords.org -

#85.對比- 英文翻译- 英语

對比 的英文翻译– 中文-英语字典和搜索引擎, 英文翻译. 於 cncontext.com -

#86.contrast - 對比,對照 - 國家教育研究院雙語詞彙

出處/學術領域, 英文詞彙, 中文詞彙. 學術名詞 ... contrast, 對比[度];反差度. 學術名詞 ... contrast, 對比;對照;對比度;對比率;反差;對襯;對照物. 學術名詞 於 terms.naer.edu.tw -

#87.蔡英文愛吃三色豆「鼓勵大家常常吃」 專家曝驚人營養價值

總統蔡英文日前在Podcast節目中分享,自己其實是「三色豆」的愛好者, ... 三色豆有時候確實沒有很好吃,但台灣自助餐的定價相當便宜,「對比從早上五 ... 於 news.ebc.net.tw -

#88.英文論文片語中,比較和對比(Compare and Contrast)用法

比較(尋找相似處)和對比(尋找差異)同為分析的過程,能幫助您暸解事物更深的層面。 比較的目的通常是為了證明看似不同的事情,但其實是類似的,而對比 ... 於 www.editing.tw -

#89.表示事物的對比,可以有哪些花式英文表達? - 每日頭條

表示A與B的對比,可以在第二句用contrast A with B的句型。 ... 這裡順便總結一下其他表示對比的英文單詞或詞組,方便大家日後在翻譯或寫作中替換 ... 於 kknews.cc -

#90.contrast⋯修圖軟體這些功能,到底是什麼意思? - Engoo

調一點對比、一點曝光,風景照瞬間從長輩圖升級意境美圖, ... 今天就一次把修圖軟體上會遇到的英文單字補齊! 1. edit 編輯(v.) 這個功能出現在修圖 ... 於 engoo.com.tw -

#91.你的iPhone 有出現通話斷線的狀況嗎?快安裝更新解決吧!

引用來源:蘋果支援(英文)、The Verge. 喜歡這篇文章嗎? 送個愛心感謝無私分享. 大餅. (qoo5430493). 2021-11-18 18:30. 於 www.eprice.com.tw -

#92.色彩對比的英文怎麼說

色彩對比的英文怎麼說. 中文拼音[shǎicǎiduìbǐ]. 色彩對比英文. color contrast. 色: 色名詞[口語] (顏色) colour; 彩: 名詞1 (多種顏色) variegated colour 2 ... 於 dict.site -

#93.1月大奶貓vs.73個月成貓!身形對比萌翻人:牠進化了

連尾巴的動作也一樣!貓咪毛色普遍有虎斑、橘白、玳瑁、三花,雖是相似顏色組成,卻也排列組合成各種模樣的喵星人,可日本網友家的這兩隻貓一隻剛 ... 於 www.nownews.com -

#94.在Teams 中變更設定

設定協助工具的高對比模式,並設定您的語言和時間。 ... 例如,如果您的裝置顯示語言設為英文(美國) ,Teams 中的日期和時間會顯示美國地區使用的格式。 於 support.microsoft.com -

#95.今昔對比英文完整相關資訊 - 數位感

提供今昔對比英文相關文章,想要了解更多今昔對比照片、今昔對比詩詞、今昔對比英文有關資訊與 ... 查阅今昔对比英文怎么说,今昔对比的英语读音例句用法和详细解释。 於 timetraxtech.com -

#96.【問答】螢幕對比英文 2021旅遊台灣

【問答】螢幕對比英文第1頁。亮度和對比度英文翻譯:brightnell and contrast…,點擊查查權威綫上辭典詳細解釋亮度和對比度英文怎麽說,怎麽用英語翻譯亮度和對比度, ... 於 travelformosa.com -

#97.比較英文compare to 跟compare with 用法差在哪?中文意思 ...

1.compare to 比作、對比. compare to 的中文意思更貼近「比作」,當我們說Compare A to B 的時候,實際上是把 ... 於 tw.englisher.info -

#98.授課計劃0177文討:翻譯理論與中英對比 - 東海大學

英文 (English) : Seminar: Translation and Technology: Translation and Dissemination of Popular Science. 必選修類別. Required/Elective, 選修, 先修課程 於 fsis.thu.edu.tw -

#99.「對決」是vs 還是vs?點錯地方,小心寫成另一個字! - 經理人

破解NG 英文 · USA stands for the United States of America.(美國代表美利堅合眾國。) · The abbreviation "vs" stands for versus.(vs 是versus 的 ... 於 www.managertoday.com.tw